7 de janeiro de 2026

A arquitetura de microsserviços tornou-se o padrão de design dominante para aplicações empresariais escaláveis. Este guia abrangente apresenta 30 perguntas essenciais da entrevista que abrangem conceitos fundamentais, padrões de design, estratégias de comunicação, práticas de implantação e técnicas de solução de problemas que os entrevistadores técnicos esperam que os candidatos dominem.

As entrevistas técnicas podem ser cansativas, mas você não precisa enfrentá-las sozinho. WiseWhisper AI fornece sugestões de respostas em tempo real durante sua entrevista, ajudando você a articular conceitos arquitetônicos complexos com confiança. Comece a praticar gratuitamente hoje mesmo.

Conceitos fundamentais de microsserviços

1. O que são microsserviços e como eles diferem da arquitetura monolítica?

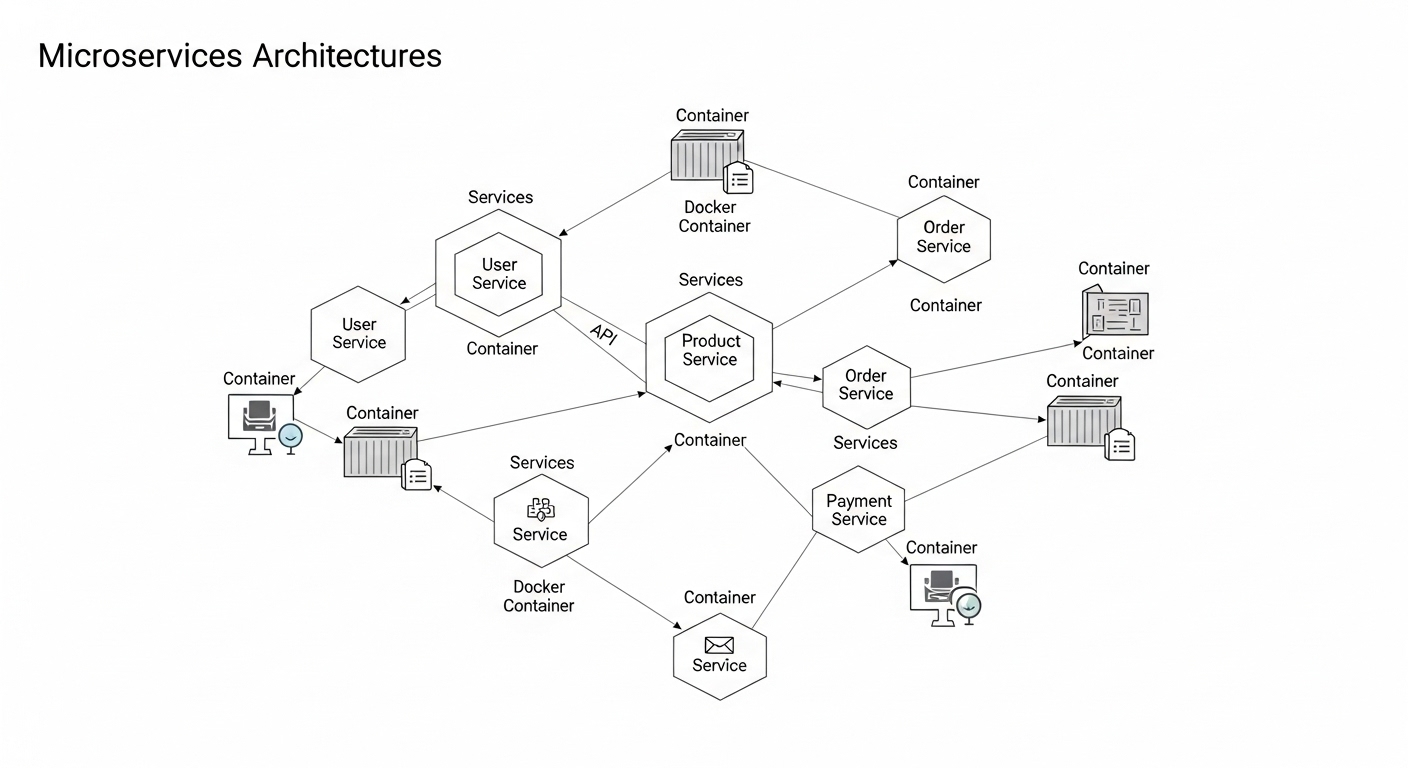

Responder: Microsserviços são um estilo arquitetônico que estrutura um aplicativo como uma coleção de pequenos serviços autônomos modelados em torno de um domínio de negócios. Cada microsserviço é executado em seu próprio processo e se comunica por meio de mecanismos leves (normalmente APIs HTTP/REST ou filas de mensagens).

Principais diferenças da arquitetura monolítica:

- Implantação: Os microsserviços são implantados de forma independente; monólitos são implantados como unidades únicas

- Escalabilidade: Serviços individuais são escalonados de forma independente em vez de escalonar todo o aplicativo

- Tecnologia: Cada microsserviço pode usar pilhas de tecnologia diferentes; monólitos usam pilha unificada

- Isolamento de falha: Uma falha de serviço não trava todo o sistema em microsserviços

- Estrutura da equipe: Equipes pequenas e multifuncionais possuem serviços versus equipes grandes que gerenciam toda a base de código

2. Quais são as principais vantagens e desvantagens dos microsserviços?

Responder:

Vantagens:

- Implantação independente e ciclos de lançamento mais rápidos

- Diversidade tecnológica – escolha as melhores ferramentas para cada serviço

- Melhor isolamento de falhas e resiliência do sistema

- Mais fácil de entender e manter bases de código menores

- Escalabilidade – dimensione apenas os serviços que precisam

Desvantagens:

- Maior complexidade operacional (monitoramento, implantação, rede)

- Desafios do sistema distribuído (latência de rede, consistência de dados)

- Difícil testar fluxos de trabalho de ponta a ponta

- O gerenciamento de dados entre serviços torna-se complexo

- Requer forte cultura DevOps e automação de infraestrutura

3. O que é o padrão Banco de Dados por Serviço e por que ele é importante?

Responder: O padrão Database-per-Service significa que cada microsserviço possui seu banco de dados privado que outros serviços não podem acessar diretamente. Os serviços interagem apenas por meio de APIs bem definidas.

Por que é importante:

- Garante um acoplamento flexível – os serviços permanecem independentes

- Permite que cada serviço escolha a tecnologia de banco de dados ideal

- Evita dependências não intencionais através do acesso direto ao banco de dados

- Permite escalabilidade independente e evolução de esquema

- Desafio: Requer gerenciamento de transações distribuídas e eventual consistência

Comunicação entre serviços

4. Quais são os principais padrões de comunicação entre microsserviços?

Responder: Existem dois estilos de comunicação principais:

1. Comunicação Síncrona (Solicitação-Resposta):

- APIs REST/HTTP – mais comuns, simples e sem estado

- gRPC — alto desempenho, protocolo binário, digitação forte

- GraphQL: consulta de dados flexível, reduz busca excessiva

- Use quando: o cliente precisar de resposta imediata

2. Comunicação assíncrona (orientada por eventos):

- Filas de mensagens (RabbitMQ, AWS SQS) — entrega ponto a ponto

- Fluxos de eventos (Kafka, AWS Kinesis) — publicação-assinatura, log de eventos

- Use quando: operações do tipo "dispare e esqueça", serviços de dissociação, necessidades de alto rendimento

5. Como funciona um API Gateway e por que usá-lo?

Responder: Um API Gateway é um servidor que atua como um ponto de entrada único para clientes em uma arquitetura de microsserviços. Ele encaminha solicitações para serviços apropriados, agrega respostas e trata de questões transversais.

Funções principais:

- Roteamento e composição de solicitações (agregando múltiplas chamadas de serviço)

- Autenticação e aplicação de autorização

- Limitação e limitação de taxa

- Tradução de protocolo (HTTP para gRPC, REST para fila de mensagens)

- Cache e transformação de resposta

- Exemplos populares: Kong, AWS API Gateway, Azure API Management, Netflix Zuul

6. Explique o padrão Service Discovery.

Responder: O Service Discovery permite que os serviços encontrem e se comuniquem entre si dinamicamente, sem endereços codificados. Essencial em ambientes de nuvem onde as instâncias de serviço aumentam/reduzem e os IPs mudam com frequência.

Dois padrões principais:

- Descoberta do lado do cliente: Cliente consulta registro de serviços (Consul, Eureka, etcd) e realiza balanceamento de carga

- Descoberta do lado do servidor: O balanceador de carga consulta registros e roteia solicitações (Kubernetes Services, AWS ELB)

Padrões de design e práticas recomendadas

7. Qual é o padrão do disjuntor?

Responder: O Circuit Breaker evita que um serviço tente repetidamente executar uma operação com probabilidade de falha, permitindo que ele falhe rapidamente e se recupere normalmente.

Estados:

- Fechado: Operação normal, solicitações passam

- Abrir: As falhas excedem o limite, as solicitações falham imediatamente sem chamar o serviço

- Meio aberto: Após o tempo limite, as solicitações limitadas testam se o serviço foi recuperado

Bibliotecas de exemplo: Netflix Hystrix, Resilience4j, Polly (.NET)

8. Descreva o padrão Saga para transações distribuídas.

Responder: Uma Saga é uma sequência de transações locais onde cada transação atualiza dados dentro de um único serviço. Se uma etapa falhar, as transações de compensação desfazem as alterações anteriores.

Duas abordagens de coordenação:

- Coreografia: Os serviços publicam eventos, outros ouvem e reagem (descentralizado, complexo para depurar)

- Orquestração: O orquestrador central informa aos serviços o que fazer (centralizado, mais fácil de monitorar)

Exemplo: pedido de comércio eletrônico que exige pagamento, estoque e coordenação de remessa

9. Qual é o padrão Strangler Fig para migração?

Responder: O padrão Strangler Fig substitui gradativamente sistemas monolíticos legados, construindo gradualmente novos microsserviços nas bordas e roteando o tráfego para longe de funcionalidades antigas.

Passos:

- Identifique o contexto limitado no monólito para extrair

- Crie um novo microsserviço implementando a mesma funcionalidade

- Rotear o tráfego através da fachada/proxy para o novo serviço

- Monitore e valide o novo comportamento do serviço

- Remova o código antigo do Monolith quando estiver confiante

- Repita até que o monólito esteja totalmente decomposto

10. Qual é o padrão CQRS (Command Query Responsibility Segregation)?

Responder: O CQRS separa as operações de leitura (consulta) e gravação (comando) em modelos diferentes. Os comandos modificam o estado; consultas recuperam dados sem efeitos colaterais.

Benefícios:

- Otimize bancos de dados de leitura e gravação de forma independente (por exemplo, PostgreSQL para gravações, Elasticsearch para leituras)

- Dimensione cargas de trabalho de leitura e gravação de maneira diferente

- Simplifique modelos de domínio complexos separando preocupações

- Frequentemente combinado com Event Sourcing para trilha de auditoria completa

Gerenciamento de dados

11. Como você lida com a consistência de dados em microsserviços?

Responder: Os microsserviços normalmente adotam consistência eventual em vez de consistência forte devido a bancos de dados distribuídos.

Estratégias:

- Arquitetura orientada a eventos: Os serviços publicam eventos quando os dados são alterados; outros atualizam seus bancos de dados consumindo eventos

- Padrão Saga: Coordenar transações distribuídas com ações compensatórias

- CQRS + Fonte de Eventos: Armazene eventos como fonte de verdade, reconstrua modelos de leitura

- Composição da API: Consulte vários serviços e agregue dados no API Gateway

- Evitar: Two-Phase Commit (2PC) entre serviços – muito lento e frágil em sistemas distribuídos

12. O que é fornecimento de eventos?

Responder: O Event Sourcing armazena o estado do aplicativo como uma sequência de eventos imutáveis, em vez de instantâneos do estado atual. O estado atual é derivado da repetição de eventos.

Vantagens:

- Trilha de auditoria completa – saiba o estado exato a qualquer momento

- Habilitar consultas temporais e depuração

- Apoie arquiteturas orientadas a eventos naturalmente

- Facilite a construção de vários modelos de leitura do mesmo fluxo de eventos

Desafios: Evolução do esquema de eventos, aumento de armazenamento, complexidade de consulta

13. Como implementar junções em microsserviços com bancos de dados separados?

Responder: Como os serviços possuem bancos de dados separados, as junções SQL tradicionais são impossíveis. Use estes padrões:

- Composição da API: Consulte vários serviços por meio de suas APIs e mescle os resultados no código do aplicativo ou no API Gateway

- CQRS com visualizações materializadas: Manter o banco de dados de leitura desnormalizado atualizado por meio de eventos de vários serviços

- Replicação de dados: Os serviços armazenam em cache os dados de referência necessários de outros serviços (troca consistência por desempenho)

- Reconsidere os limites: Se junções frequentes forem necessárias, os serviços poderão ser muito granulares – considere a fusão

Implantação e DevOps

14. Qual o papel dos contêineres (Docker) nos microsserviços?

Responder: Os contêineres fornecem embalagens leves e portáteis que encapsulam microsserviços com todas as dependências, garantindo um comportamento consistente durante o desenvolvimento, testes e produção.

Principais benefícios:

- Isolamento: Cada serviço é executado em seu próprio contêiner com recursos dedicados

- Consistência: o mesmo contêiner é executado de forma idêntica em todos os lugares

- Eficiência: inicialização mais rápida que VMs, maior densidade

- Controle de versão: imagens Docker marcadas com versões para reversão

- Ecossistema: Integra-se com orquestradores como Kubernetes, service meshes, pipelines de CI/CD

15. Como o Kubernetes oferece suporte à arquitetura de microsserviços?

Responder: Kubernetes é uma plataforma de orquestração de contêineres que automatiza a implantação, o escalonamento e o gerenciamento de microsserviços.

Capacidades principais:

- Descoberta de serviço e balanceamento de carga: DNS integrado e balanceamento de carga para serviços

- Escalonamento automático: O Horizontal Pod Autoscaler dimensiona serviços com base em métricas personalizadas/de CPU

- Autocura: Reinicia contêineres com falha e substitui instâncias não íntegras

- Atualizações contínuas: Implante novas versões sem tempo de inatividade

- Gerenciamento de configuração: ConfigMaps e Secrets para configurações específicas do ambiente

- Gerenciamento de recursos: Limites de CPU/memória e solicitações por serviço

16. O que é Service Mesh e quando você usaria um?

Responder: Um Service Mesh é uma camada de infraestrutura dedicada que lida com a comunicação, segurança e observabilidade serviço a serviço sem alterar o código do aplicativo.

Implementações populares: Istio, Linkerd, Consul Connect

Características:

- Gerenciamento de tráfego (balanceamento de carga, novas tentativas, disjuntores, timeouts)

- Segurança (TLS mútuo, autenticação, autorização)

- Observabilidade (rastreamento distribuído, métricas, registro)

- Divisão de tráfego para implantações canário e testes A/B

Use quando: Gerenciar comunicações complexas entre serviços em escala (normalmente mais de 10 serviços)

17. Explique as estratégias de implantação Azul-Verde e Canárias.

Responder:

Implantação Azul-Verde:

- Execute dois ambientes de produção idênticos (Azul = atual, Verde = nova versão)

- Implante a nova versão no Green, teste-a completamente

- Mude o tráfego de azul para verde instantaneamente por meio do balanceador de carga

- Mantenha o Blue funcionando para uma reversão rápida se surgirem problemas

Implantação Canário:

- Implantar nova versão para um pequeno subconjunto de usuários (por exemplo, 5%)

- Monitore métricas (taxas de erro, latência, KPIs de negócios)

- Aumente gradualmente o tráfego para a nova versão, se estiver estável

- Reverter imediatamente se forem detectados problemas

Monitoramento e solução de problemas

18. Como você monitora microsserviços em produção?

Responder: A observabilidade de microsserviços requer três pilares:

1. Métricas:

- Colete dados de série temporal: taxas de solicitação, taxas de erro, latências (método RED)

- Utilização de recursos: CPU, memória, disco, rede

- Ferramentas: Prometheus + Grafana, Datadog, New Relic, CloudWatch

2. Registros:

- O registro centralizado agrega registros de todos os serviços

- O registro estruturado (JSON) permite pesquisa e filtragem

- Ferramentas: ELK Stack (Elasticsearch, Logstash, Kibana), Splunk, Loki

3. Rastreamento Distribuído:

- Rastreie solicitações entre limites de serviço com IDs de correlação

- Visualize dependências de serviço e gargalos de latência

- Ferramentas: Jaeger, Zipkin, AWS X-Ray, OpenTelemetry

19. O que é rastreamento distribuído e por que é crítico?

Responder: O rastreamento distribuído rastreia uma única solicitação de usuário à medida que ela flui por vários microsserviços, capturando tempo e metadados para cada salto.

Por que crítico:

- Identifique qual serviço causa tempos de resposta lentos

- Falhas de depuração abrangendo vários serviços

- Entenda as dependências do serviço e os padrões de chamada

- Detecte falhas em cascata e tente novamente tempestades

Implementação: Cada serviço propaga o ID de rastreamento e o ID de span nos cabeçalhos de solicitação; sistema de rastreamento (Jaeger/Zipkin) agrega extensões em visualização completa de rastreamento

20. Como você lida com cascatas de falhas em microsserviços?

Responder: As cascatas de falha ocorrem quando um serviço com falha faz com que os serviços dependentes falhem. Estratégias de prevenção:

- Disjuntores: Evite chamadas para serviços com falha, falhe rapidamente

- Tempos limite: Defina tempos limite agressivos para evitar o esgotamento do pool de threads

- Anteparas: Isole recursos (pools de threads, conexões) por dependência

- Limitação de taxa: Proteja os serviços contra picos de tráfego esmagadores

- Degradação Graciosa: Retornar dados em cache/padrão em vez de erros, quando possível

- Verificações de saúde: Kubernetes remove instâncias não íntegras do balanceamento de carga

Segurança

21. Como implementar autenticação e autorização em microsserviços?

Responder:

Autenticação (Quem é você?):

- API Gateway lida com autenticação inicial (OAuth 2.0, OpenID Connect)

- Emitir tokens JWT contendo identidade e declarações do usuário

- Os serviços validam a assinatura JWT sem chamar o serviço de autenticação (sem estado)

Autorização (o que você pode fazer?):

- Incorporar funções/permissões de usuário em declarações JWT

- Cada serviço impõe regras de autorização com base em declarações

- Use mecanismo de política centralizado (OPA - Open Policy Agent) para regras complexas

- Autenticação serviço a serviço: chaves mTLS ou API gerenciadas por service mesh

22. O que é mTLS (Mutual TLS) e por que usá-lo?

Responder: O TLS mútuo exige que o cliente e o servidor apresentem certificados para autenticação, estabelecendo conexões criptografadas e autenticadas entre microsserviços.

Benefícios:

- Criptografia: todo o tráfego entre serviços criptografado em trânsito

- Autenticação: os serviços comprovam a identidade com certificados

- Segurança Zero-Trust: nunca confie apenas na localização da rede

- Conformidade: Atende aos requisitos regulamentares para proteção de dados

As malhas de serviço (Istio, Linkerd) automatizam o gerenciamento e a rotação de certificados, tornando o mTLS prático em escala.

23. Como proteger microsserviços contra ataques DDoS?

Responder:

- Limitação de taxa do gateway de API: Limitar solicitações por usuário/endereço IP por janela de tempo

- Proteção DDoS do provedor de nuvem: AWS Shield, proteção Azure DDoS, Cloudflare

- Firewall de aplicativos da Web (WAF): Filtre solicitações maliciosas na borda

- Escalonamento automático: Aumente temporariamente a escala para absorver picos de tráfego

- Disjuntores e anteparos: Evite que o esgotamento de recursos se espalhe

- Cache: Caches CDN reduzem a carga nos serviços de origem

Tópicos Avançados

24. Qual é o padrão Backends for Frontends (BFF)?

Responder: O BFF cria serviços de back-end separados e otimizados para clientes front-end específicos (web, dispositivos móveis, IoT), em vez de forçar uma API genérica em todos os clientes.

Por que é útil:

- Os aplicativos móveis precisam de cargas menores do que os navegadores da web

- Clientes diferentes exigem lógicas de agregação de dados diferentes

- As equipes de front-end podem personalizar seus melhores amigos sem afetar os outros

- Evita o inchaço do API Gateway único com lógica específica do cliente

25. Explique o padrão Sidecar.

Responder: Um Sidecar é um contêiner auxiliar implantado junto com o contêiner principal do aplicativo no mesmo pod, fornecendo funcionalidade auxiliar sem modificar o código do aplicativo.

Usos comuns:

- Logging: Sidecar encaminha logs para sistema centralizado

- Proxy: sidecars de malha de serviço (Envoy) cuidam do gerenciamento de tráfego

- Monitoramento: Sidecar exporta métricas para Prometheus

- Configuração: Sidecar sincroniza arquivos de configuração de fonte externa

Exemplo: o Istio injeta o proxy secundário Envoy em cada pod para controle de tráfego e observabilidade.

26. Como você cria versões de APIs de microsserviços?

Responder:

- Versionamento de URI: /api/v1/users vs. /api/v2/users (roteamento explícito e claro)

- Versionamento de cabeçalho: Aceitar: application/vnd.company.v1+json (URIs mais limpos)

- Parâmetro de consulta: /api/users?version=2 (raramente recomendado)

- Versionamento Semântico: Use major.minor.patch para APIs internas

- Estratégia de depreciação: Oferece suporte a versões antigas durante o período de carência, avisa os clientes e desativa gradualmente

Melhor prática: Mantenha a compatibilidade com versões anteriores quando possível; introduzir novas versões apenas para alterações significativas.

27. Quais são as implicações do teorema CAP para microsserviços?

Responder: O teorema CAP afirma que os sistemas distribuídos podem garantir apenas duas das três propriedades: Consistência, Disponibilidade, Tolerância de Partição.

Para microsserviços:

- As partições de rede (P) são inevitáveis em sistemas distribuídos – devem ser toleradas

- A compensação é entre consistência e disponibilidade durante partições

- Sistemas CP: Prefira consistência (por exemplo, transações financeiras) — rejeite gravações durante a partição

- Sistemas AP: Prefira a disponibilidade (por exemplo, feeds de mídia social) – aceite dados desatualizados durante a partição

A maioria das arquiteturas de microsserviços escolhe AP (consistência eventual) porque a disponibilidade é crítica para a experiência do usuário.

28. Como testar microsserviços de maneira eficaz?

Responder: Pirâmide de testes adaptada para microsserviços:

1. Testes Unitários (70%):

- Teste funções/classes individuais isoladamente

- Rápido, confiável, executado em pipeline de CI

2. Testes de Integração (20%):

- Serviço de teste com banco de dados real, filas de mensagens

- Use Docker Compose para ambiente de teste

- Simule dependências de serviços externos com ferramentas como WireMock, Pact

3. Testes de Contrato:

- Verifique contratos de API entre serviços (contratos orientados ao consumidor)

- Ferramentas: Pacto, Contrato Spring Cloud

4. Testes ponta a ponta (10%):

- Teste fluxos de trabalho completos de usuários em todos os serviços

- Execute em ambiente de teste, minimize devido à fragilidade

29. Quando você NÃO deve usar microsserviços?

Responder: Os microsserviços adicionam complexidade que pode superar os benefícios nestes cenários:

- Equipes Pequenas: Menos de 5 a 10 desenvolvedores não conseguem gerenciar a sobrecarga operacional

- Aplicações simples: Aplicativos CRUD sem domínios complexos não precisam de decomposição

- DevOps imaturos: Sem CI/CD, monitoramento, automação e microsserviços tornam-se incontroláveis

- Limites pouco claros: Se você não conseguir identificar limites de serviço claros, comece com o monólito modular

- Acoplamento apertado: Serviços que mudam constantemente juntos provavelmente deveriam permanecer juntos

- Inicializações iniciais: Ao iterar rapidamente na adequação do produto ao mercado, o Monolith acelera o desenvolvimento

Recomendação: Comece com um monólito bem estruturado e migre para microsserviços quando a complexidade justificar a sobrecarga.

30. Como você lida com o gerenciamento de configuração em microsserviços?

Responder:

- Servidores de configuração centralizados: Spring Cloud Config, Consul, armazenamento de parâmetros do AWS Systems Manager

- Variáveis de ambiente: Princípio do aplicativo de 12 fatores – injetar configuração em tempo de execução por meio de env vars

- ConfigMaps e segredos do Kubernetes: Desacoplar configuração de imagens de contêiner

- Sinalizadores de recursos: Configuração dinâmica sem reimplantação (LaunchDarkly, Unleash)

- Versionamento: Armazene a configuração no Git com código para controle de versão e reversão

- Atualização dinâmica: Mudanças de configuração de recarga de serviços sem reinicialização (Spring Cloud Bus)

Melhor prática: Nunca codifique a configuração; externalizar tudo específico do ambiente.

Aceite sua entrevista de microsserviços

O WiseWhisper fornece sugestões de respostas em tempo real durante entrevistas técnicas, ajudando você a responder com confiança a perguntas complexas sobre microsserviços.

Experimente o WiseWhisper GrátisDicas de preparação para entrevistas

Ao se preparar para entrevistas de microsserviços:

- Enfatize as compensações: Os entrevistadores querem ouvir você discutir prós/contras, não respostas absolutas

- Use exemplos reais: Faça referência às tecnologias reais que você usou (Kubernetes, Kafka, etc.)

- Desenhar Diagramas: Os esboços de arquitetura do quadro branco tornam as explicações mais claras

- Conheça profundamente os padrões: Entenda quando aplicar Circuit Breaker vs. Saga vs. Event Sourcing

- Discuta as falhas: Compartilhe lições aprendidas com interrupções ou erros arquitetônicos

- Fique atualizado: Mencione desenvolvimentos recentes (sidecars WASM, eBPF, padrões sem servidor)

Para funções técnicas que exigem conhecimento profundo de microsserviços, prepare exemplos práticos com base em sua experiência na construção, implantação e operação de sistemas distribuídos em escala. Concentre-se em demonstrar compreensão teórica e experiência prática de implementação.

As entrevistas técnicas são desafiadoras, mas você não precisa enfrentá-las sozinho. O WiseWhisper fornece suporte em tempo real durante entrevistas de microsserviços, ajudando você a articular conceitos arquitetônicos complexos com confiança. Comece gratuitamente hoje.

O que nossos usuários dizem

Minha entrevista correu muito bem hoje e principalmente por sua causa!

Eu realmente aprecio a plataforma e seu papel em ajudar os usuários a se prepararem para entrevistas.

WiseWhisper me deu a confiança que eu precisava durante minhas entrevistas técnicas. As sugestões em tempo real foram precisas e me ajudaram a conseguir o emprego!

Usar o WiseWhisper para praticar antes das entrevistas me deu muito mais confiança. Me senti preparado e pronto para responder qualquer dúvida!

Eu costumava ficar muito ansioso antes das entrevistas, mas o WiseWhisper mudou isso completamente. Saber que tinha o apoio da IA acalmou meus nervos e me ajudou a ter o melhor desempenho.

Wise Whisper é uma virada de jogo para o mercado de trabalho injusto. Isso realmente me ajudou a ter sucesso em minha entrevista. Se eu tiver alguma entrevista em um futuro próximo, com certeza me inscreverei novamente!

Prepare-se para entrevistas técnicas com estes guias relacionados: